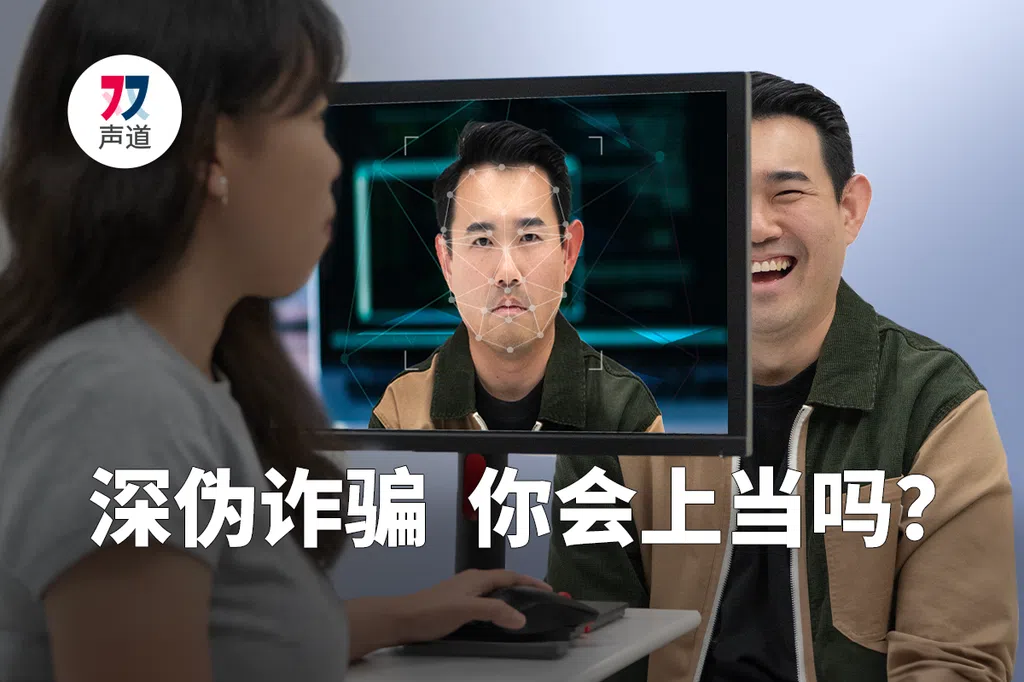

画面灯光出现差异,人物脸部表情僵硬、不协调或不眨眼,都是深伪画面或视频的“破绽”。从深伪技术衍生出来的深伪骗案让人不安,但网安专家指出,现阶段的深伪视频依旧“有迹可循”,公众应先小心判断,不要轻易相信所看到或听到的。

随着生成式人工智能的迅速发展,不法之徒开始利用深伪技术(deepfake)行骗,我国政要的视频前阵子曾遭人恶意篡改。李显龙总理和副总理黄循财去年12月就在脸书贴文,提醒公众别相信涉及两人的深伪视频。

受访的网安专家指出,深伪技术早在2014年就已出现,并于2017年起被不法之徒用来进行违法勾当。

网安公司卡巴斯基亚太地区董事经理邢翰充说,深伪是运用人工智能和机器学习的科技来篡改画面和视频内容。“这个词在2017年由社交网络平台Reddit的一名用户‘创造’,2019年引起广泛关注,这项技术也从一开始的伪造艺人视频,发展成为诈骗工具。”

他说,深伪的核心目的是为了散播假消息诋毁他人,或进行不法活动,本地政治人物近期被移花接木用来推广投资的骗局就是一例。“从个人角度来说,罪犯可通过深伪技术伪造受害者的亲朋戚友,用来诱导受害者转账。深伪技术也能用来进行勒索或敲诈等。”

公众可根据一些细节辨别真伪

受访的网安专家指出,现阶段的深伪技术仍“有迹可循”,公众只要仔细观察收到的照片或视频,还是可以根据一些细节辨别真伪。

网安公司ManageEngine网络风险专家拉姆·维迪雅纳登(Ram Vaidyanathan)说,首先可以观察视频人物的脸部表情或动作是否和语音有差,再来就是观察人物脸部或身体周围是否有奇怪的扭曲或干扰(glitches)。另一个可留意的地方,就是人物周围的影子和亮度是否不一致。

南洋理工大学计算机科学与工程学院吴荣亮博士,在接受《联合早报》的《双声道》视频系列主持人刘永健访问时说:“深伪视频的破绽通常出现在下巴、嘴型和眼镜上,多加留意就能发现一些不自然的痕迹。”

Fortinet网络安全平台新加坡和文莱国家主管黄晓慧说:“我们看到不少人使用生成式人工智能,在视频中改变声音和内容。不少机构也采用类似技术来提升效率,但这意味着人们得提高警惕,避免坠入骗局。”

拉姆说,在抗衡深伪的课题上,除了投入资源发展科技侦查深伪内容之外,加强宣导、提高公众对深伪内容的认识亦是可行途径之一。“也可考虑加强对制作和发送深伪内容相关的法律和准则,以对罪犯起到阻遏作用。”

邢翰充则认为应该“用魔法打败魔法”,利用机器人学习并掌握生成深伪技术,用来侦测由深伪技术生成的视频或音频。