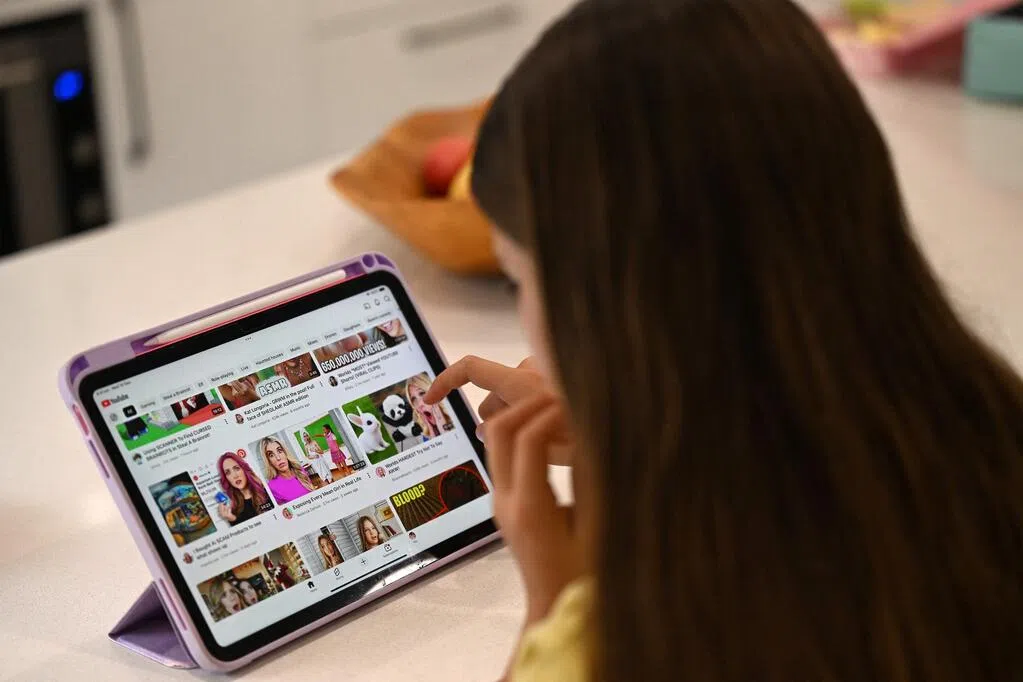

(伦敦讯)从下周起,社交平台Instagram将推出一项新功能,如果孩子在短时间内多次搜索与自残或自杀相关的内容,使用儿童监管工具的家长将接获系统通知。不过,多家慈善机构指出,这项新功能并不足够。

这是Instagram母公司Meta首次主动提醒家长孩子在搜索有害内容,而不仅仅是屏蔽搜索并将用户引导至外部帮助。

澳大利亚、英国、美国和加拿大已注册家长监督功能的用户,将从下周开始收到警报通知,新功能今年将扩展至其他地区。Meta今年也会为其AI聊天机器人引入类似的提醒机制。

英国广播公司引述Instagram的公告说,绝大多数青少年不会主动搜索自杀或自残内容。一旦他们输入这类词语,平台会阻止搜索,并引导他们访问求助资源和支持热线。提醒将通过电子邮件、短信或 WhatsApp等家长提供的联系方式发送。系统也会提供指导信息,帮助家长更好地与子女讨论敏感问题。

然而,自杀预防慈善机构莫莉·罗斯基金会(Molly Rose Foundation)批评道,这些措施“可能弊大于利”。基金会首席执行官伯罗斯指出:“这些仓促的通知会让家长们惊慌失措,却未必准备好进行随之而来的敏感而艰难的对话。”

这个基金会由莫莉·罗素(Molly Russell)的家人创立。莫莉于2017年自杀身亡,年仅14岁,此前她曾在Instagram等平台上浏览过自残和自杀内容。

莫莉的父亲伊恩说:“设想一下,你正在上班,却收到一条信息说‘你的孩子正在考虑结束自己的生命’……我不知道自己会如何反应。即使Meta说他们会在那种恐慌时刻为家长提供支持,我不认为这是明智的做法。”

莫莉·罗斯基金会等慈善机构认为,Meta的公告几乎等同于承认在儿童用户保护方面还有更多工作要做。

预防青少年自杀慈善机构Papyrus的首席执行官弗林则乐见此举,但他说,Meta “忽视了真正的问题,那就是儿童和青少年仍会卷入一个黑暗而危险的网络世界”。

儿童慈善机构5Rights的执行董事莉巴林顿-利奇认为,Meta应重新审视其系统,“从设计之初就使其符合儿童的年龄特点”。

网络欺凌研究中心联合主任辛杜贾则说:“你不能只是给家长发个通知就让他们自己处理,Meta似乎也明白这一点。”